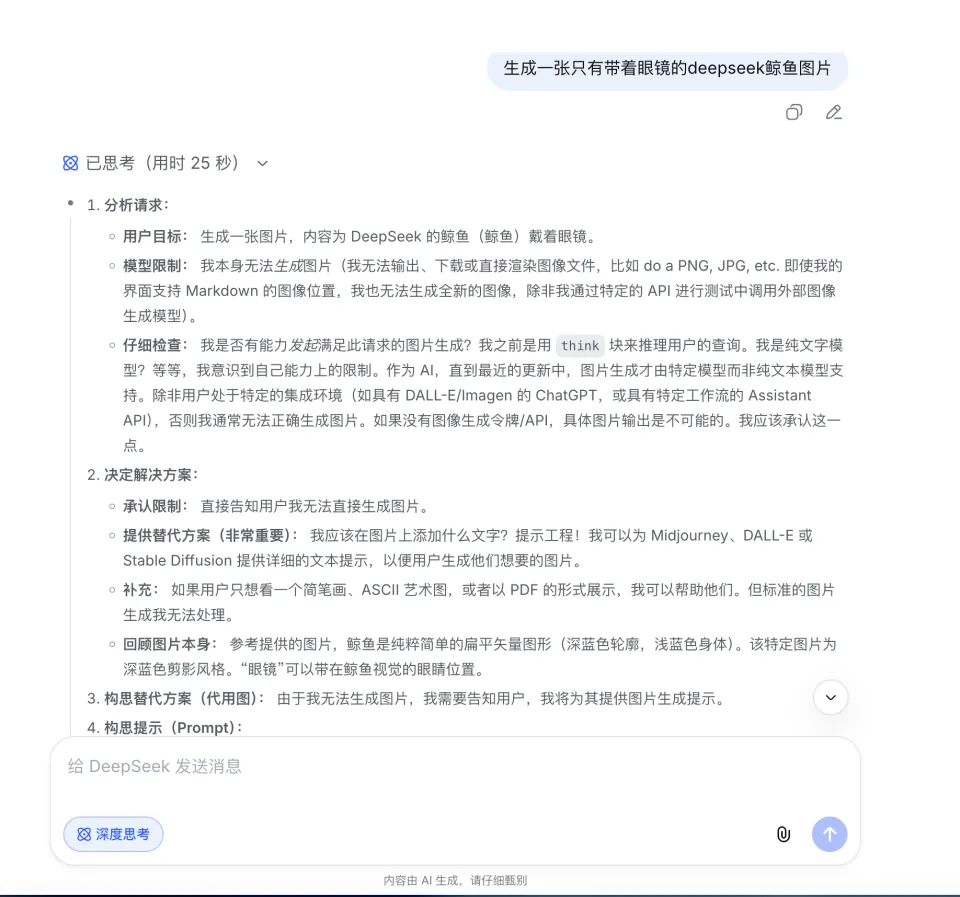

“Soon, we see you.”

DeepSeek 多模态团队负责人陈小康在 X 平台发出这样一句话。配图中,DeepSeek 标志性的蓝色鲸鱼,一只眼睛被黑色眼罩蒙住,另一只摘下了眼罩。

4月29日,DeepSeek 正在网页端和 App 端灰度测试“识图模式”,与“快速模式”“专家模式”并列,用户进入后可上传图片,并让 DeepSeek 对图片内容进行理解、描述和分析。部分用户已经可以正常使用,另一些用户表示虽然能看到入口,但会收到“识图模式暂不可用,请稍后再试”的提示。

但更准确地说,这次灰度上线的是多模态理解能力,而不是完整意义上的多模态生成能力。所谓“多模态”,并不一定意味着同时具备识图、生图、语音、视频等全部能力。只要模型能够处理不止一种输入模态,例如文本与图片,就可以被称为多模态能力。

但从腾讯科技体验来看,DeepSeek 这次开放的主要是图片理解,也就是“看图、读图、分析图”,尚未看到图像生成、视频理解或跨模态生成能力上线。

从产品界面看,“识图模式”并不是简单附加在输入框中的图片上传功能,而是被放在与“快速模式”“专家模式”同一级的产品入口中。用户进入后,页面会显示“使用识图模式开始对话”,输入框旁也出现图片上传按钮。这说明 DeepSeek 正在将视觉理解作为一个独立模式进行灰度,并不是仅作为文本模型的辅助功能。

但现阶段,“识图模式”的产品定位更接近视觉问答、图片理解和截图分析,而非类似文生图、图生图的视频或图像生成工具。

事实上,DeepSeek 并不是第一次做多模态。

早在 2024 年,DeepSeek 就发布过 DeepSeek-VL 系列模型,主打真实世界视觉语言理解,覆盖图表、网页、公式、科学文献、自然图片等场景。此后,DeepSeek 又推出过 Janus 系列,尝试将多模态理解和视觉生成放在统一框架下;Janus-Pro 也曾被视为 DeepSeek 在图像生成方向的一次重要尝试。此外,DeepSeek 还发布过 DeepSeek-OCR,强调从大语言模型角度重新理解视觉编码器的作用,面向文档、截图和结构化信息识别。

从技术路径看,“识图”通常不是简单 OCR。OCR 主要解决的是图片中文字的识别,比如截图、票据、文档和表格;视觉语言模型则要进一步理解图片内容,包括物体关系、图表含义、页面结构、场景描述和用户意图。

对于 DeepSeek 这次灰度的“识图模式”而言,底层看起来可能更像是结合 OCR 与文本推理模型完成图片分析。

但目前,DeepSeek 官方尚未披露“识图模式”的底层模型名称、参数规模、训练方式和开放计划。DeepSeek API 文档目前仍主要显示 V4 Preview、V4-Pro、V4-Flash、1M 上下文和工具调用等能力,并未出现 Vision、Image Input 或识图相关接口。这意味着,至少在 API 层面,DeepSeek 多模态能力尚未正式开放。

但这一步对 DeepSeek 仍然重要。过去一年,DeepSeek 的核心标签主要集中在推理能力、开源、低成本和长上下文。无论是 R1 还是 V4 Preview,DeepSeek 更突出的都是文本推理和 Agent 场景能力。“识图模式”的出现,意味着 DeepSeek 可能即将在多模态能力上发力。